比特大陆AI芯片正式亮相,“矿机”霸主的惊艳一枪

传闻已久的比特大陆人工智能芯片终于面世。

在昨天举办的AI WORLD 2017世界人工智能大会上,比特大陆CEO詹克团先生公布了该公司人工智能品牌SOPHON(算丰,取“算天地玄空,丰认知智能”之意),并带来了全球首款张量加速计算芯片BM1680,以及板卡SC1/SC1+、智能视频分析服务器SS1等重量级产品。这个来源于科幻小说《三体》的品牌名,体现了比特大陆对他们AI芯片的野心。

从矿机领导者到人工智能

在刘慈欣的小说《三体》里面,SOPHON是一个智能机器人,它是由三体人制造出来锁死地球科技的强人工智能体。在人工智能火热的今日,比特大陆给他们的AI新品牌取名SOPHON,其背后的含义不言而喻。

过去两年,人工智能的突然爆发,吸引了众多芯片厂商以不同形态投身其中,当中以英伟达的GPU和Xilinx的FPGA最具代表性。与此同期,多款专为AI设计的ASIC芯片的也相继而至,全球AI芯片竞争进入了白热化阶段。作为ASIC芯片的一贯支持者,比特大陆的詹克团先生认为,ASIC设计起来比CPU、GPU简单,且更适合实现深度学习算法,因此他们选择推出ASIC芯片为人工智能助力。SOPHON TPU芯片BM1680就是他们在这个领域的新尝试。

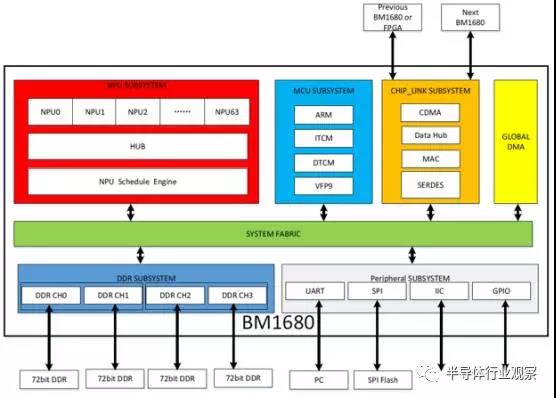

BM1680芯片架构图

据介绍,这是一颗面向深度学习应用的张量计算加速处理的专用定制芯片,适用于CNN、RNN、DNN等深度神经网络的推理预测(Inference)和训练(Training)。芯片由64 NPU构成,特殊设计的NPU调度引擎(Scheduling Engine)可以提供强大的数据吞吐能力,将数据输入到神经元核心(Neuron Processor Cores)。BM1680采用改进型脉动阵列结构。单芯片能够提供2TFlops单精度加速计算能力,片上32MB SRAM拥有高带宽,在片外有DDR4内存接口,单芯片可支持高达16GB DDR内存。这就是BM1680交出的数据。

比特大陆还通过在芯片内集成高度定制的BMDNN Chip link芯片链路技术,实现在高速SerDes上提供稳定,灵活,低延迟的链路,可以使多个BM1680芯片一起工作,使其作为一个统一的系统,提供更高的处理能力。BM1680成在亮相后,迅速成为AI芯片领域的一匹黑马,这和比特大陆的背景密不可分。

成立于2013年的比特大陆是一个专注于在超高性能计算研发的企业,公司成功开发并量产了多款ASIC定制芯片和整机系统,专挖比特币的矿机就是他们的一个重要产品。据介绍,全球80%甚至90%的矿机都是他们提供的。过去几年里,他们也一直在推动矿机用ASIC芯片迭代,满足更新的需求。官方资料显示,比特大其陆自主研发的第五代芯片BM1387,是全球功耗最低、性能最高的运算加速芯片,而其量产规模达数十亿颗。也就是在这个研发过程中,他们积累了更多的ASIC设计研发经验,AI芯片的面世也就水到渠成。

除了这颗芯片,比特大陆还的同时带来了两张深度学习加速卡和一台智能视频分析Sophon SS1,加速人工智能的普及。

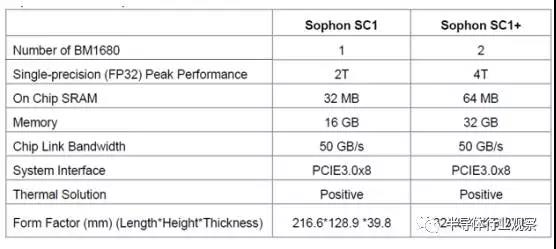

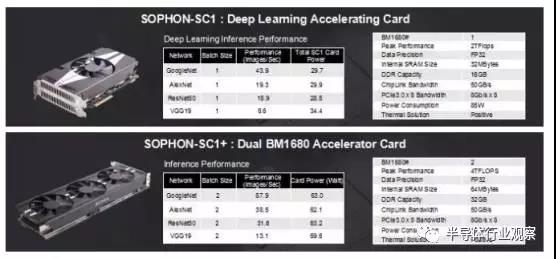

从官方介绍得知,比特大陆提供了Sophon SC1和SC1+两款深度学习加速板卡产品。其中SC1 拥有一颗高性能的BM1680芯片,而SC1+ 则是双BM1680级联架构,芯片之间通过高速SerDes Chiplink互联,为深度学习计算带来全新的加速体验。

SC1和SC1+的架构类似,都通过PCIE的总线连入系统。具备高达2TFlops / 4TFlops的单卡计算能力(单精度),单芯片On Chip SRAM高达32MB,较大的SRAM适合装载整个神经网络模型。同时在板卡上搭载16GB 或32GB DDR4内存,大容量存储适合存储较大的神经网络模型。

“在这个卡上面,我们可以把这些Googlenet、VGG等等这些经典Net也都跑起来了。如果把卡插在Server上面,我们就可以实现人脸检测、行人的检测和属性的分析和人脸识别等”,詹克团强调。

基于最新研发的SOPHON SC1/SC1+深度学习加速卡和对于图像识别算法深度理解而打造的深度学习服务器SOPHON SS1是比特大陆带来的另一款新产品,专门为视频监控、互联网图像等多种应用场景提供强大的深度学习加速能力。

比特大陆方面透露,SOPHON SS1提供了一整套针对视频和图像识别技术的深度学习解决方案。系统核心组件是两张SOPHON SC1(或SC1+)深度学习加速卡,通过PCIE接口实现与应用系统的连接。SS1的应用系统基于X86 CPU打造,以供启动、存储管理及深度学习SDK协调之用。SS1的整个系统被浓缩进一个4机架单位(4U)机箱中,集电源、冷却、网络、多系统互联及文件系统于一体,客户可以在此基础上实现快速的二次开发或系统集成,最大程度上方便了用户对深度学习系统的利用。

比特大陆服务器集成的人脸/人体检测、机非人视频结构化分析等等DEMO,展示行业应用方案能力场景,落地 视频分析安防行业方案。展示 人检测,车检测等等。BITMAIN也将快速快速迭代的视频结构化API。

值得一提的是,SOPHON拥有软硬件全栈开发的能力,和各个层次的工具链能力,从硬件、驱动、指令集、线性代数加速核心数学库,RUNTIME库,BM Deploy的Inference部署工具,FFT加速库,深度学习框架(Caffe,Darknet, Tensorflow,MXNet等)。真正实现了软件、硬件的协同设计和一体化的优化,实现深度学习应用在硬件上的最佳优化性能。

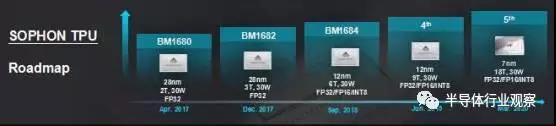

根据比特大陆的路线图,其第二代芯片1682下个月发布,也是采用16纳米工艺,功耗差不多还是30瓦,计算能力大概是3T。第三代芯片会在明年的9月份发布,会采用12纳米工艺,功耗还是涉及在30瓦,计算能力到6T,这应该都没有什么问题。这个芯片我们会只持更多的数据精度,把16位和8位给支持起来。詹克团补充说。

对人工智能的一些理解

从矿机芯片杀入玩家众多的人工智能芯片市场,按照詹克团的说法,他们做出这个决定是基于以下考虑。从他们角度看来,在比特币上小有成就之后,就感觉自己手里好像拿着一把锤子,到处看哪里都是钉子,就在找钉子的过程中,他们发现深度学习是非常适合用锤子对付的钉子,所以便开始做这个深度学习计算芯片。

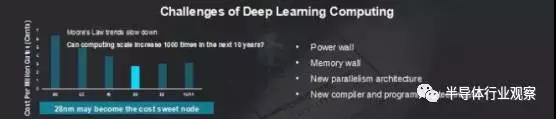

落实到芯片开发选择上面,他们认为,对于深度学习计算,最大的挑战依然是功耗,包括大规模集群的功耗,芯片的功耗。另外一个很大的挑战就是Memory wall。但他们明确了深度学习做的,实际上是多维矩阵计算这个根本,主张云端深度学习往张量(Tensor)处理靠拢。

在考虑怎么做多维矩阵的各种计算。怎么做Tensor的计算之后,他们认为传统的CPU架构是不适合了,便确定了深度学习用在云端高性能芯片的体系结构,需要慢慢往Tensor架构靠拢。这就是为什么他们选择脉动阵列架构做芯片的原因。这个架构能够用硬件实现多维的数据搬运和计算任务的调度,获得非常高的性能,比较适合用在云端做加速。值得一提的是,这和谷歌的TPU架构是一样的。

阐述了对云端芯片的看法以后,詹克团先生也表达了他对终端深度学习的看法:他认为这是更加困难的,做这种架构由于不得不受限于单芯片的功耗,不能太大,一般来说这种芯片很难超过10瓦,所以设计这种的体系结构是非常有挑战的一件事情。

最后,詹克团指出,比特大陆在深度学习,在AI领域的使命,或者说目标,就是和他们在数字货币上面做的事情一样,通过一点一点的、一代又一代的芯片,一代又一代的产品不断迭代,把产品做到极致,做到最好,服务好需要用到深度学习加速服务的用户和应用。

他同时强调,AI产业之间要合作,今天这个时代商业的合作是大于竞争的,尤其在人工智能领域,有无数的处女地等待我们去开发,大家应该共同把这个蛋糕做得更大。更多和合作伙伴进行深度合作,包括开源,慢慢就可以把生态做起来。

文/半导体行业观察 李寿鹏

声明:此文出于传递更多信息之目的,并不意味着赞同其观点或证实其描述。本网站所提供的信息,只供参考之用。